用AI写了文章,发出去流量很差——这是很多自媒体人2026年最头疼的问题之一。

不是内容不好,是平台能「闻」到AI味,然后把流量掐掉了。

这篇文章聊5个去除AI痕迹的实用技巧,以及一个自媒体场景专用的处理工具。

平台为什么能识别AI内容?

2026年小红书强制要求AI生成内容标识,未标识的被发现后直接限流。但更早之前,平台就已经在用算法识别AI内容了——标识是表层要求,算法识别才是底层逻辑。

平台算法识别AI内容,主要靠以下几个维度:

- 结构规律性:AI文章普遍遵循「总分总」结构,每段用「首先/其次/再者/最后」开头

- 信息密度均匀:每句话都很「充实」,没有铺垫、没有悬念、没有情绪波动

- 缺乏个人声音:没有第一人称视角、没有真实体验、没有情绪点

- 过度连接词:大量使用「综上所述」「因此」「由此可见」等总结连接词

- 统计特征指纹:句式复杂度变化幅度太小,读起来「整整齐齐」

这些特征不是一两个词能改变的。换个同义词,结构还是那个结构,算法还是能识别出来。

5个去除AI痕迹的实用技巧

技巧1:打破「总分总」结构

AI最爱「首先…其次…最后…总结」这套结构。改写时,先把这个框架拆掉。

尝试用倒序结构(先说结论/体验,再解释原因)或平行结构(几个场景并列,没有严格顺序),会更像真实的人在说话。

技巧2:加入真实的情绪点

AI写不出真实的情绪,只会模仿情绪词汇。「非常棒」「十分重要」都是模仿出来的,没有质感。

真实情绪是具体的:「我测试到第三次的时候已经想摔键盘了」「结果出来的时候我愣了一秒钟」。这些细节算法判断不出来,因为太具体了。

技巧3:删掉「过度礼貌」的开头和结尾

AI文章的开头经常是「在当今社会…」「随着XXX的不断发展…」,结尾是「综上所述,我们可以看到…」。

这些句子删掉。直接进入内容,读者不需要背景铺垫,平台算法也不需要。

技巧4:加入具体数字和个人细节

泛指替换成具体:「很多人」→「我测了32个样本」,「效果不错」→「从78%降到了12%」。

具体数字和个人细节很难被算法识别为AI生成,因为AI默认不会编造这么具体的数字。

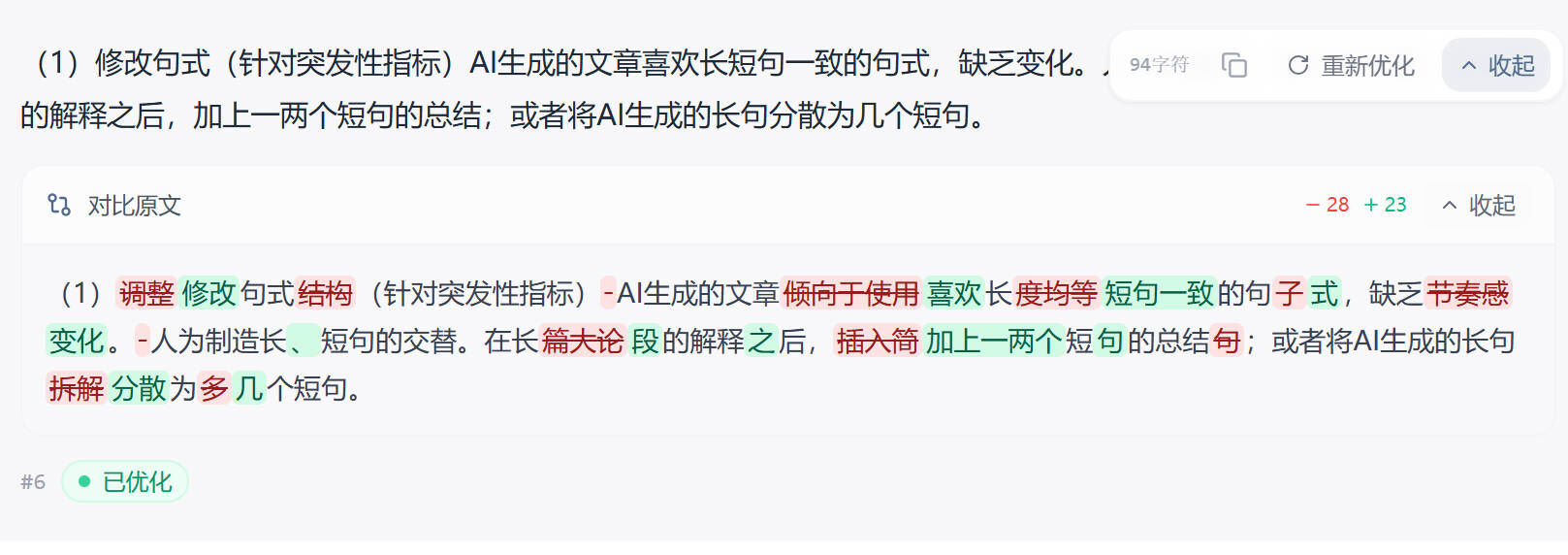

技巧5:用工具处理统计特征层

前4个技巧是手动改写,适合篇幅短的内容。如果你每天有大量AI辅助内容需要发布,手动改写效率太低。

这时候需要一个专门处理统计特征层的工具。去AIGC(www.quaigc.com)有专门的自媒体场景模式:注入个人声音和节奏感,打破AI套路结构,适配公众号/小红书/知乎等平台调性。

和学术降AI不同,自媒体场景处理的是「AI味」和「平台推荐权重」——不是为了过检测系统,是为了让文章读起来更有人味,让平台算法给更高的推荐权重。

自媒体降AI和论文降AI有什么不同?

| 维度 | 论文降AI | 自媒体降AI |

|---|---|---|

| 目标 | 通过知网AIGC检测 | 提高平台推荐权重 |

| 检测方式 | 知网等检测系统评分 | 平台算法 + 用户停留/互动数据 |

| 处理风格 | 保留学术严谨性 | 注入个性化声音和平台调性 |

| 评判标准 | AI率数字 | 流量、互动、涨粉速度 |

去AIGC的三场景适配(学术/自媒体/分发)就是针对这个差异做的——用同一套引擎,但针对不同场景输出不同风格的改写结果。

处理后还需要做什么?

工具处理完,不代表可以直接发布。还需要:

加入平台专属调性:小红书要加话题标签式结构和emoji;公众号要有明显的段落感和金句;知乎要有更多论证性表达。这些是平台偏好,工具不会替你加,但工具去掉AI骨架后,你加起来会更自然。

检查平台敏感词:降AI工具不处理敏感词。发布前用平台自带的检测功能或第三方敏感词工具过一遍,避免被判违规。

加个人真实体验:至少加1-2处「我的真实体验」,比如「我实际用了一周,发现XX」。这是算法最难判定的AI特征消除方式。

总结

5个技巧:打破总分总结构 → 加情绪点 → 删过度礼貌句式 → 具体化数字和细节 → 工具处理统计特征

工具选择:自媒体场景要选有专门场景适配的工具,不是所有降AI工具都做了自媒体调性适配

发布前还要做:平台调性适配 + 敏感词检查 + 加个人真实体验

工具直达:去AIGC(www.quaigc.com)——三场景深度适配,自媒体模式专门注入个人声音,500字免费体验